InternLM Chat 7B 8K - InternLM Chat 7B 8K

模型详细情况和参数

InternLM Chat 7B 8K

- 模型全称

- InternLM Chat 7B 8K

- 模型简称

- InternLM Chat 7B 8K

- 模型类型

- 聊天大模型

- 发布日期

- 2023-06-03

- 预训练文件大小

- 14.5GB

- 是否支持中文(中文优化)

- 是

- 最高支持的上下文长度

- 8K

- 模型参数数量(亿)

- 70.0

- 模型代码开源协议

- Apache 2.0

- 预训练结果开源商用情况

- 免费商用授权 - 免费商用授权

- 模型GitHub链接

- https://github.com/InternLM/InternLM

- 模型HuggingFace链接

- https://huggingface.co/internlm/internlm-chat-7b-8k

- 在线演示地址

- 暂无

- 基础模型

- 无基础模型

- 发布机构

InternLM Chat 7B 8K 简介

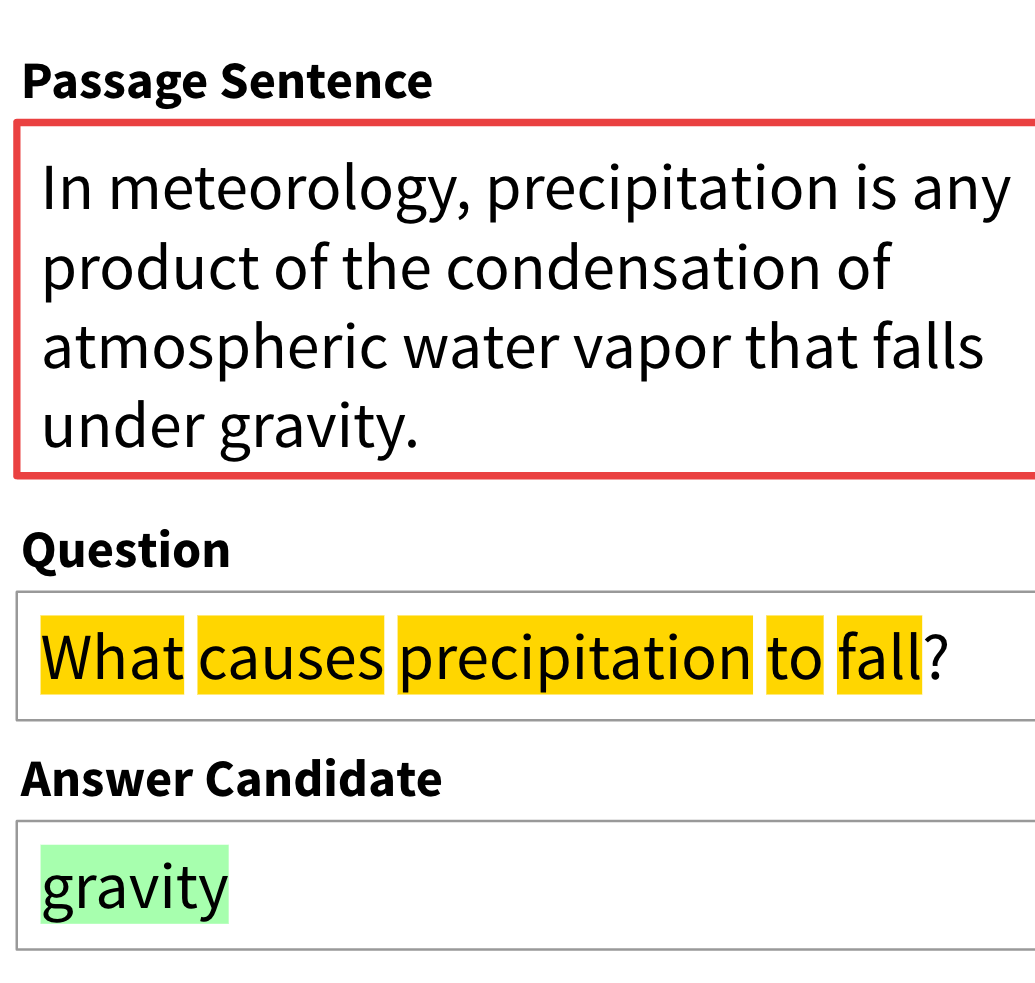

InternLM是由上海AI实验室、商汤科技、香港中文大学、上海交通大学一起发布的一个支持中文的多语言大模型。该模型在1.6万亿tokens上训练得到。

InternLM在多个方面都取得了很好的效果,包括只是理解、阅读理解、数学、编码等。根据官方的描述,InternLM比开源模型好很多,甚至好于ChatGPT!

更重要的是,InternLM对中文的支持很好,也非常理解中国文化。

下图是与当前著名大模型的对比,可以看到,InternLM基本上是除了GPT-4外最好的模型!

InternLM模型在AGIEval上的测试结果:

欢迎大家关注DataLearner官方微信,接受最新的AI模型和技术推送

InternLM Chat 7B 8K所属的领域

InternLM Chat 7B 8K相关的任务