大模型的发展速度很快,对于需要学习部署使用大模型的人来说,显卡是一个必不可少的资源。使用公有云租用显卡对于初学者和技术验证来说成本很划算。DataLearnerAI在此推荐一个国内的合法的按分钟计费的4090显卡公有云服务提供商仙宫云,可以按分钟租用24GB显存的4090显卡公有云实例,非常具有吸引力~

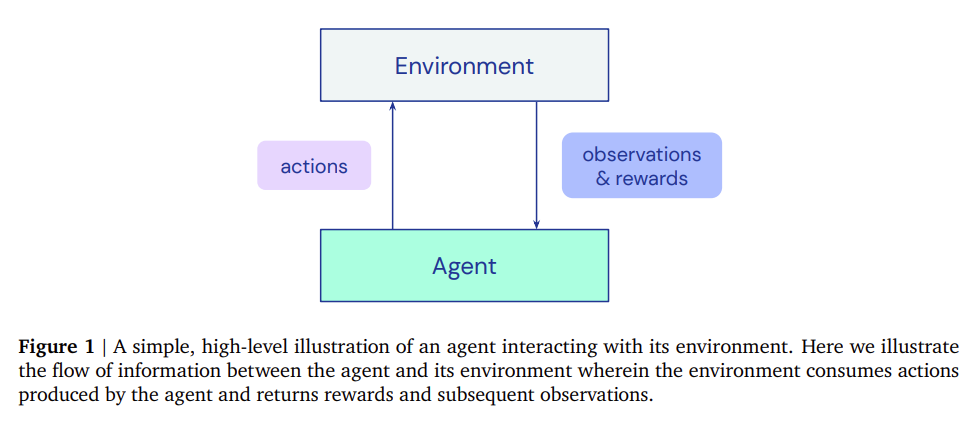

深度强化学习(RL)导致了许多最近的和突破性的进展。然而,强化学习的实施并不容易,与使深度学习拥有PyTorch这样简单的框架支持不同,强化学习的训练缺少强有力的工具支撑。为了解决这些问题,DeepMind发布了Acme,一个用于构建新的RL算法的框架,该框架是专门为实现代理而设计的

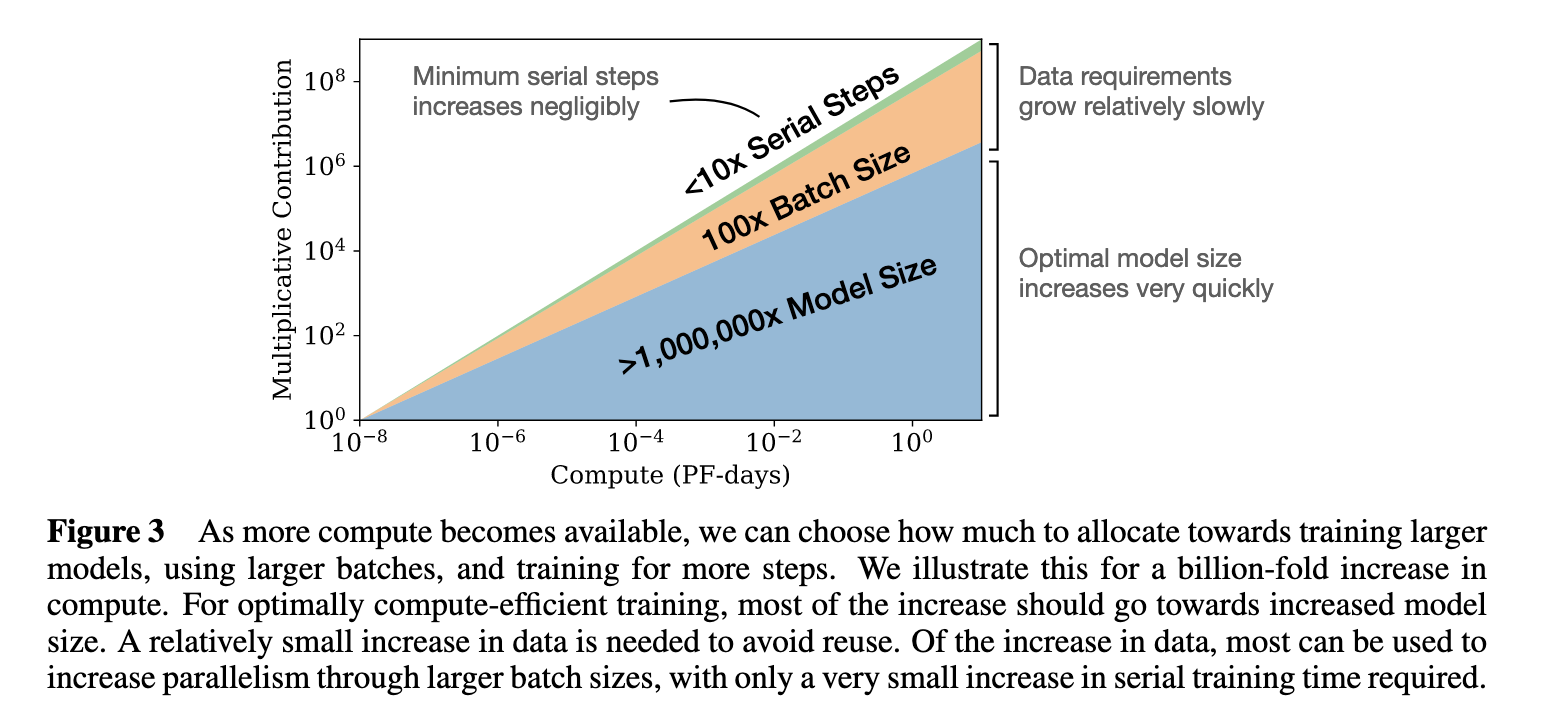

3月29日,DeepMind发表了一篇论文,"Training Compute-Optimal Large Language Models",表明基本上每个人--OpenAI、DeepMind、微软等--都在用极不理想的计算方式训练大型语言模型。论文认为这些模型对计算的使用一直处于非常不理想的状态。并提出了新的模型缩放规律。

今日推荐

OpenAI官网测试GPT-4.5介绍页面,最新Bing搜索泄露GPT-4.5的特性,上下文长度拓展到256K!

一文总结13个国内外ChatGPT平替产品:是时候可以不那么依赖ChatGPT了~

如何基于PyTorch来优化大模型训练的内存(显存)使用:8种方法总结

HuggingFace官方宣布将对GGUF格式的大模型文件增加更多的支持,未来可以直接在HF上查看GGUF文件的元数据信息!

AI大模型领域的热门技术——Embedding入门介绍以及为什么Embedding在大语言模型中很重要

Meta开源Llama3.3-70B-Instruct模型:大模型后训练的佳作,性能超越4050亿参数规模的Llama3.1-405B大模型!