大模型的发展速度很快,对于需要学习部署使用大模型的人来说,显卡是一个必不可少的资源。使用公有云租用显卡对于初学者和技术验证来说成本很划算。DataLearnerAI在此推荐一个国内的合法的按分钟计费的4090显卡公有云服务提供商仙宫云,可以按分钟租用24GB显存的4090显卡公有云实例,非常具有吸引力~

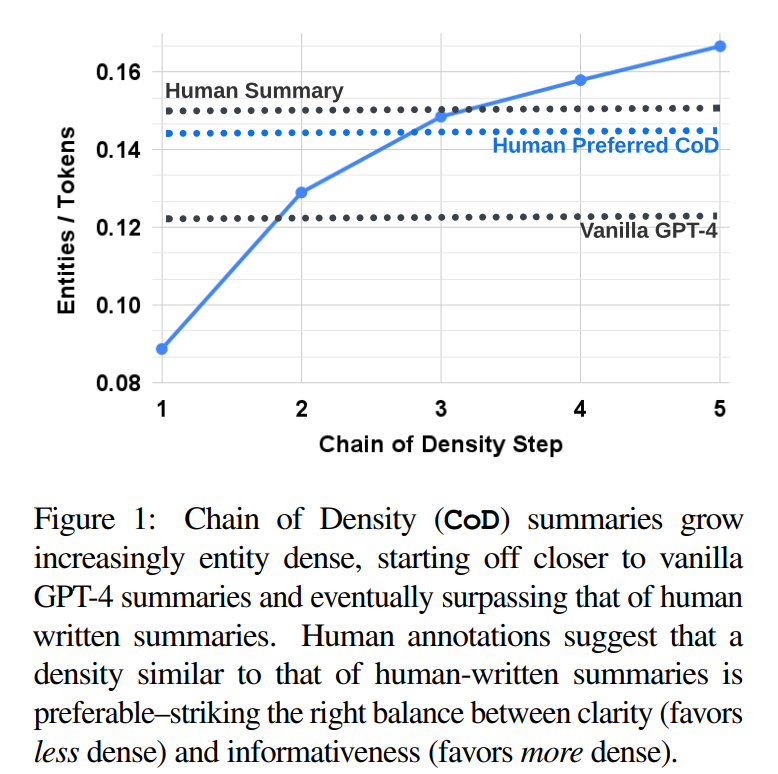

基于文本做文本摘要的时候,摘要所包含的信息密度是一个非常重要的问题。正常情况下我们希望文本摘要既能覆盖更多的重要信息,又要保持简洁和连贯。SalesforceAI与MIT等机构的研究人员联合发布了一个最新的Prompt技巧,称为密度链提示方法(Chain of Density Prompting),可以提取有信息含量的简洁摘要。

今日推荐

OpenAI发布企业使用的ChatGPT:没有限制且更快的GPT-4、数据隔离、基于GPT-4的高级数据分析功能,但是暂不支持私有化部署

对比关系生成模型(Comparative Relation Generative Model)

突破英特尔CPU+英伟达GPU的大模型训练硬件组合:苹果与AMD都有新进展!

分解机(Factorization Machine, FM)模型简介以及如何使用SGD、ALS和MCMC求解分解机

OpenAI开始提供大模型(GPT系列模型)的提示缓存(Prompt Caching):GPT-4o系列模型输入价格下降一半,访问速度提升80%

CerebrasAI开源可以在iPhone上运行的30亿参数大模型:BTLM-3B-8K,免费可商用,支持最高8K上下文输入,仅需3GB显存