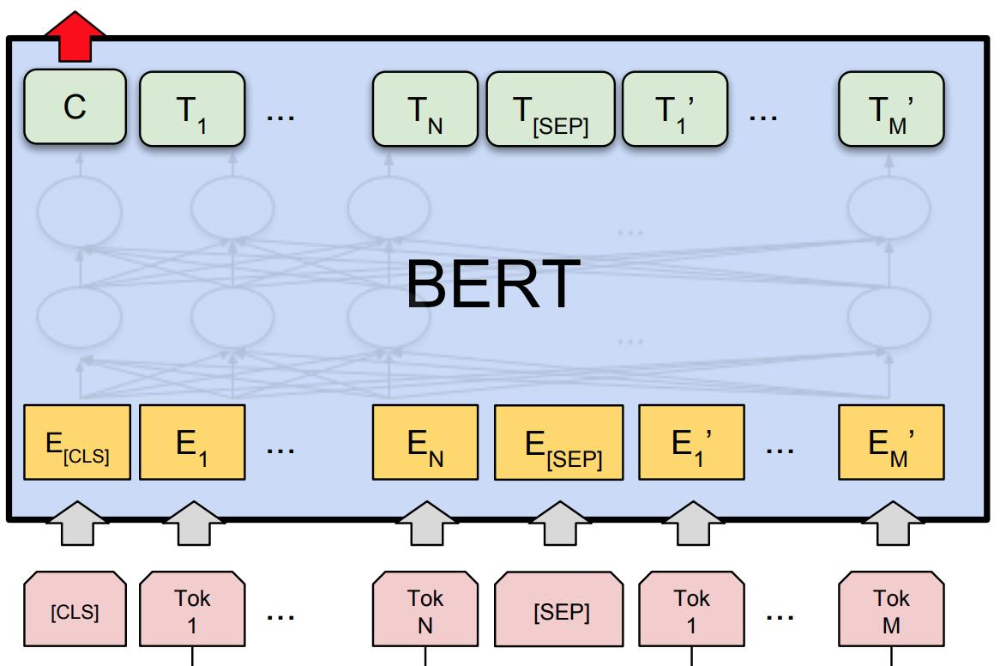

Multi-label Text Classification using BERT

这个博客介绍的是使用BERT做多标签分类的方法。这里主要解决的问题是Kaggle比赛中的恶意评论划分的为(Toxic Comment Classification)

案例来自 medium.com

添加时间 2019/06/08 14:12:05

BERT在各个领域任务中的应用及其思路

这里是知乎的一篇专栏,主要介绍了几十篇关于使用BERT完成其他任务的思路。包括问答系统(QA)、信息检索(IR)、文本摘要(AS)等。

案例来自 zhuanlan.zhihu.com

添加时间 2019/06/10 09:24:54