AI大模型学习

原创AI博客

大模型技术资讯

大模型评测排行

大模型评测排行榜

大模型数学推理能力排行榜

大模型代码编程能力排行榜

大模型图片编辑能力排行榜

LMSys ChatBot Arena排行榜

Berkeley大模型工具使用能力排行榜

大模型综合能力排行榜(旧)

大模型编程能力排行榜(旧)

OpenLLMLeaderboard中国站

AI大模型大全

最新大模型列表

大模型部署教程

大模型对比工具

大模型评测基准

大模型评测基准

SWE Bench Verified

ARC-AGI-2

AIME 2025

FrontierMath-Tier4

MMMU

AI Agents列表

AI资源仓库

AI领域与任务

AI研究机构

AI数据集

AI开源工具

数据推荐

国产AI大模型生态全览

AI模型概览图

AI模型月报

AI基础大模型

AI工具导航

AI大模型工具导航网站

在线聊天大模型列表

Multilevel Bayesian Models of Categorical Data Annotation

小木

Unpublished manuscript

2008-09

3343

2017/05/14 23:58:14

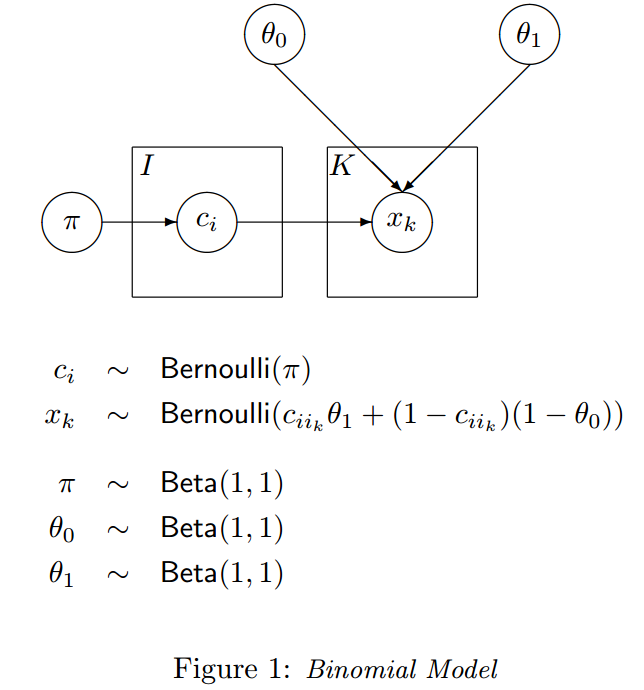

这篇文章主要讲述使用多层贝叶斯(Multilevel Bayesian,感觉大多时候都应该是分层贝叶斯)模型为数据标注建模。为分类任务添加标签是一项非常重要的工作。但由于标注者自己认知的缺陷或者是多个标注者发生标注冲突时候,如何确定最终标签是一个非常重要的问题。作者的这项工作主要是从原始的标注结果中做一系列预测,最重要的是预测正确的标注结果。通过多层贝叶斯来组合个人与群体级别的数据我们可以较好的预测正确的数据标签。作者做了好几项的推断工作。我们将分别记录一下。首先从一个二项式模型,它不与标注者和项目的变化而变化。然后作者将模型拓展到多层次的。 ####二项式模型 作者的模型的示意图(图模型)如下: <center> </center> 作者针对的模型主要是二分类模型,也就说每个数据的标注结果只有1和0两种。假设有$J$个标注者和$I$个待标注的项目,$c_i$表示第$i$个项目的真实标签,假设$\pi$是标签为1的项目的流行度,我们有$c_i \sim \textbf{Bernoulli}(\pi)$,即数据结果为1的概率是取决于$\pi$这个值。$x_k$表示用户的标注结果。$\theta$是表示特殊性和敏感性的变量,也就是说,当项目$i$的真实标签为1(即$c_i = 1$)的时候,标注者标注该项目为1的可能性为$\theta_1$(也就是说$x_k \sim \textbf{Bernoulli} (\theta_1 | c_i=1)$),当项目的真实标签为0的时候,标注者标注该项目为1的可能性为$1-\theta_0$(即$x_k \sim \textbf{Bernoulli} (1-\theta_0 | c_i=0)$),合在一起就是: ```math x_k \sim \textbf{Bernoulli}(c_i\theta_1+(1-c_i)(1-\theta_0)) ``` 那么,所有的变量的联合概率为: ```math p(\pi,c,\theta_0,\theta_1,x) = p(\pi)p(\theta_0)p(\theta_1)\prod_ip(c_i|\pi)\prod_kp(x_k|\theta_0,\theta_1,c) ``` 在给定数据标注结果的情况下,作者最终需要估计的后验概率为$p(\pi,c,\theta_0,\theta_1|x)$,作者使用Gibbs抽样来解决这个问题。

赏

支付宝扫码打赏

如果文章对您有帮助,欢迎打赏鼓励作者

Back to Top