大模型的发展速度很快,对于需要学习部署使用大模型的人来说,显卡是一个必不可少的资源。使用公有云租用显卡对于初学者和技术验证来说成本很划算。DataLearnerAI在此推荐一个国内的合法的按分钟计费的4090显卡公有云服务提供商仙宫云,可以按分钟租用24GB显存的4090显卡公有云实例,非常具有吸引力~

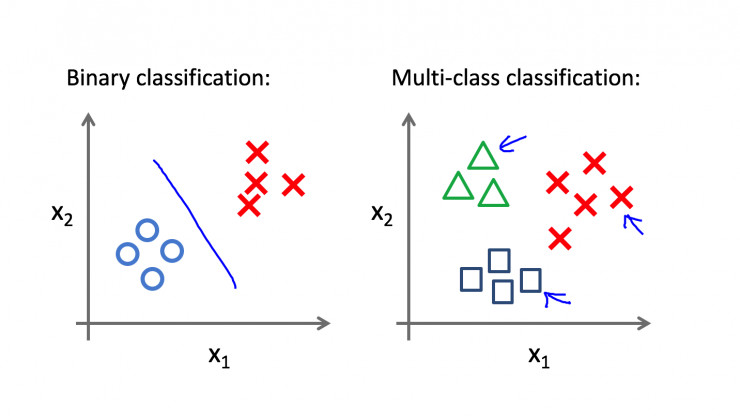

本文转自雷锋网,原文《通过从零开始实现一个感知机模型,我学到了这些》,作者:恒亮,文章转载已获授权。感知器(英语:Perceptron)是Frank Rosenblatt在1957年就职于Cornell航空实验室(Cornell Aeronautical Laboratory)时所发明的一种人工神经网络。它可以被视为一种最简单形式的前馈神经网络,是一种二元线性分类器。本文介绍了搭建感知机模型的基本操作也包含了作者的一些心得。

数据结构中,自平衡二叉查找树搜索效率高,但是需要通过旋转和变色维护平衡。而列表虽然简单,但是对元素的查找需要比对列表中的每个元素,查找速度较慢。为了兼顾列表的简单易用,并提高查找效率,跳跃列表(Skip List)应运而生。

深度学习本质上是表示学习,它通过多层非线性神经网络模型从底层特征中学习出对具体任务而言更有效的高级抽象特征。针对一个具体的任务,我们往往会遇到这种情况:需要用一个模型学习出特征表示,然后将学习出的特征表示作为另一个模型的输入。这就要求我们会获取模型中间层的输出,下面以具体代码形式介绍两种具体方法。

在使用Dask进行两个dataframe的concatenate操作的时候抛出ValueError,本文记录这个错误以及解决方案。

基于算法的业务或者说AI的应用在这几年发展的很快。但是,在实际应用的场景中,我们经常会遇到一些非常奇怪的偏差现象。例如,Facebook将黑人标记为灵长类动物、城市图像识别系统将公交车上的董明珠形象广告识别为闯红灯的人等。算法系统出现偏差的原因有很多。本篇博客将总结在数据获取相关方面可能导致模型出现偏差的原因。

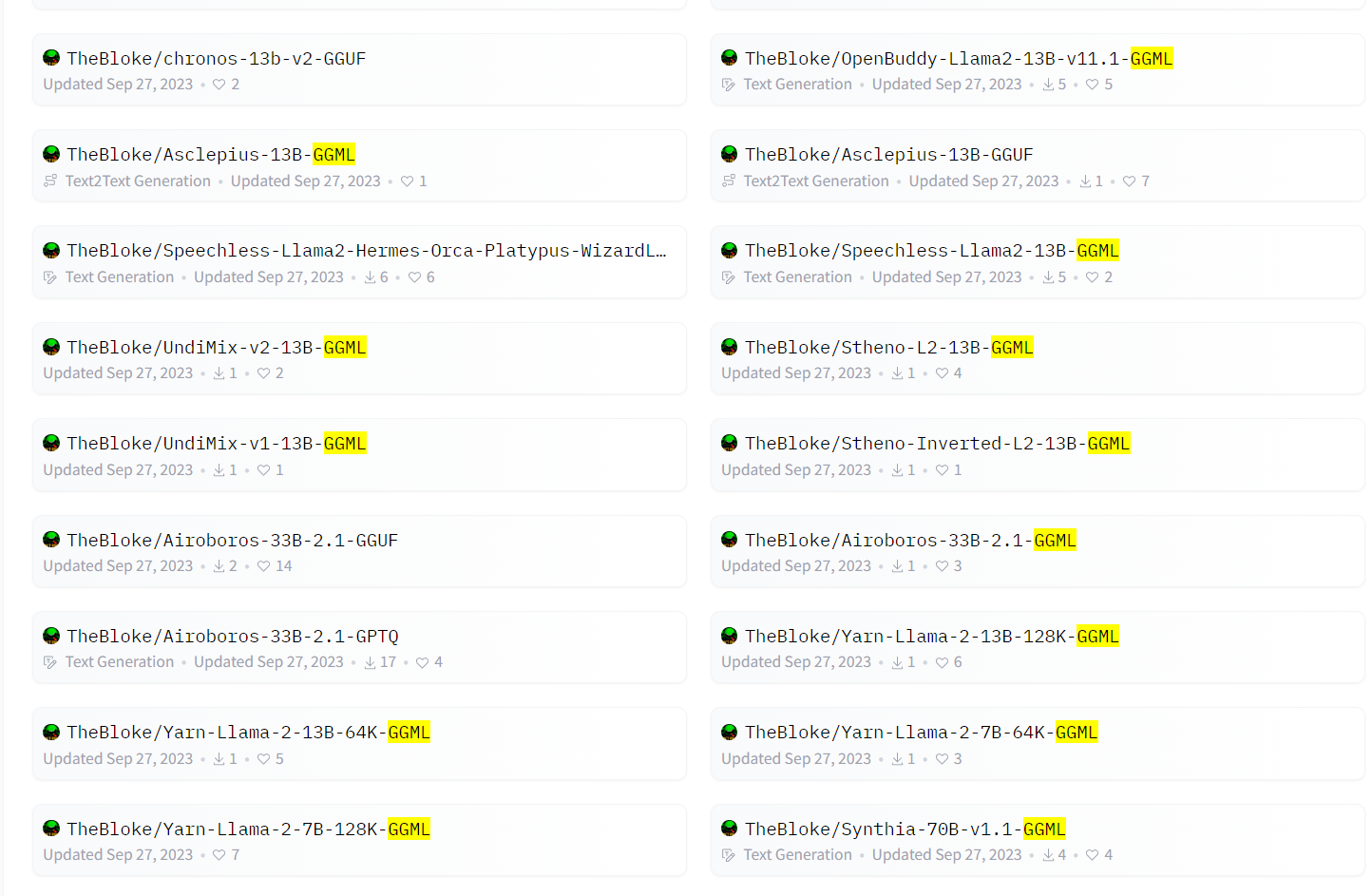

GGML是在大模型领域常见的一种文件格式。HuggingFace上著名的开发者Tom Jobbins经常发布带有GGML名称字样的大模型。通常是模型名+GGML后缀,那么这个名字的模型是什么?GGML格式的文件名的大模型是什么样的大模型格式?如何使用?本文将简单介绍。

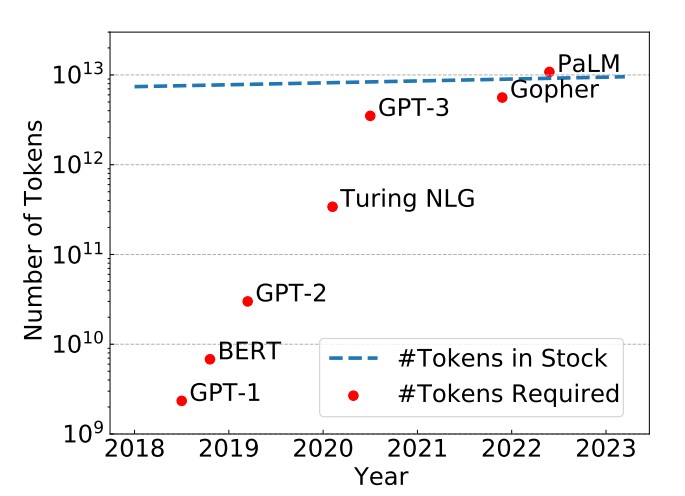

epoch是一个重要的深度学习概念,它指的是模型训练过程中完成的一次全体训练样本的全部训练迭代。然而,在LLM时代,很多模型的epoch只有1次或者几次。这似乎与我们之前理解的模型训练充分有不一致。那么,为什么这些大语言模型的epoch次数都很少。如果我们自己训练大语言模型,那么epoch次数设置为1是否足够,我们是否需要更多的训练?

AI Playground最近的LLaMA2、Stable Diffusion XL等模型的进展也让大家看到了最新最强大的模型的能力。但是,对于大多数人来说,这些模型的使用依然具有较高的门槛,除了硬件资源消耗大,本身的部署也不容易。而支撑这些模型的一个重要的硬件因素就是英伟达的显卡。显卡已经超越一般理财,变得越来越贵。因此,基于大模型的免费服务成本也很高,而今天,英伟达官方的NGC网站推出了新的几款可以免费使用的大模型,包括聊天大模型LLaMA2、文本生成图片大模型Stable Diffusion等,基于

今日推荐

阿里开源全模态大模型Qwen2.5-Omni-7B:支持文本、语音、视频、图像任意模态输入,可以实时生成文本或者语音,文本理解能力接近GPT-4o-mini,开源且免费商用

Sam Altman宣布未来几周将发布GPT-4.5,几个月后发布GPT-5,未来免费用户也可以无限量使用GPT-5!

ToolTalk:微软发布的一个用以评测大语言模型工具使用能力的评测工具和评测数据集

财大气粗!英伟达官方AI Playground提供可以免费使用的Stable Diffusion XL、LLaMA2、CLIP等模型

截止目前为止最大的国产开源大模型发布:元象科技开源XVERSE-65B大模型,16K上下文,免费商用

强化学习进入分布式时代——DeepMind分布式强化学习框架ACME发布