大模型的发展速度很快,对于需要学习部署使用大模型的人来说,显卡是一个必不可少的资源。使用公有云租用显卡对于初学者和技术验证来说成本很划算。DataLearnerAI在此推荐一个国内的合法的按分钟计费的4090显卡公有云服务提供商仙宫云,可以按分钟租用24GB显存的4090显卡公有云实例,非常具有吸引力~

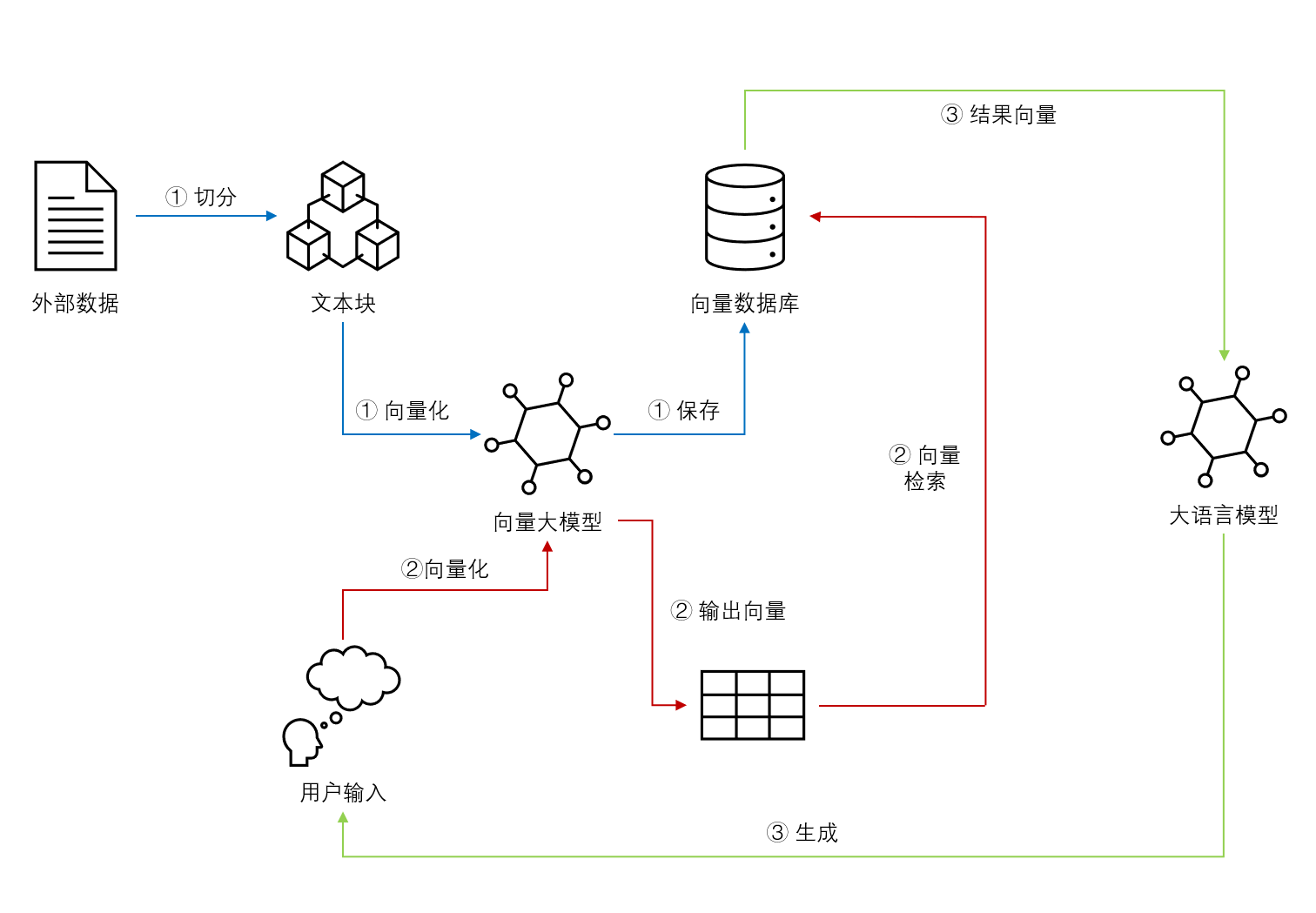

基于Embedding模型的大语言模型检索增强生成(Retrieval Augmented Generation,RAG)可以让大语言模型获取最新的或者私有的数据来回答用户的问题,具有很好的前景。但是,检索的覆盖范围、准确性和排序结果对大模型的生成结果有很大的影响。Llamaindex最近对比了主流的`embedding`模型和`reranker`在检索增强生成领域的效果,十分值得关注参考。

本文是Steffen Rendle的文章BPR: Bayesian Personalized Ranking from Implicit Feedback的译文

今日推荐

马斯克旗下xAI发布Grok-1.5,相比较开源的Grok-1,各项性能大幅提升,接近GPT-4!

Let's Encrypt的Certbot自动生成证书和自动更新证书

GPT-4-Turbo的128K长度上下文性能如何?超过73K Tokens的数据支持依然不太好!

MistralAI可能即将发布新的大语言模型,Mistral Next悄悄登场Chat Arena!

重磅!第二代通义千问大模型开源,阿里巴巴一口气开源了30个不同参数规模的模型,其中Qwen1.5-72B仅次于GPT-4.

最新发布!截止目前最强大的最高支持65k输入的开源可商用AI大模型:MPT-7B!

2023年AI与开源进展总结:来自LightningAI首席AI科学家Sebastian Raschka的2023年年度AI发展总结