人工智能初创企业Hugging Face是什么样的企业——HuggingFace简介

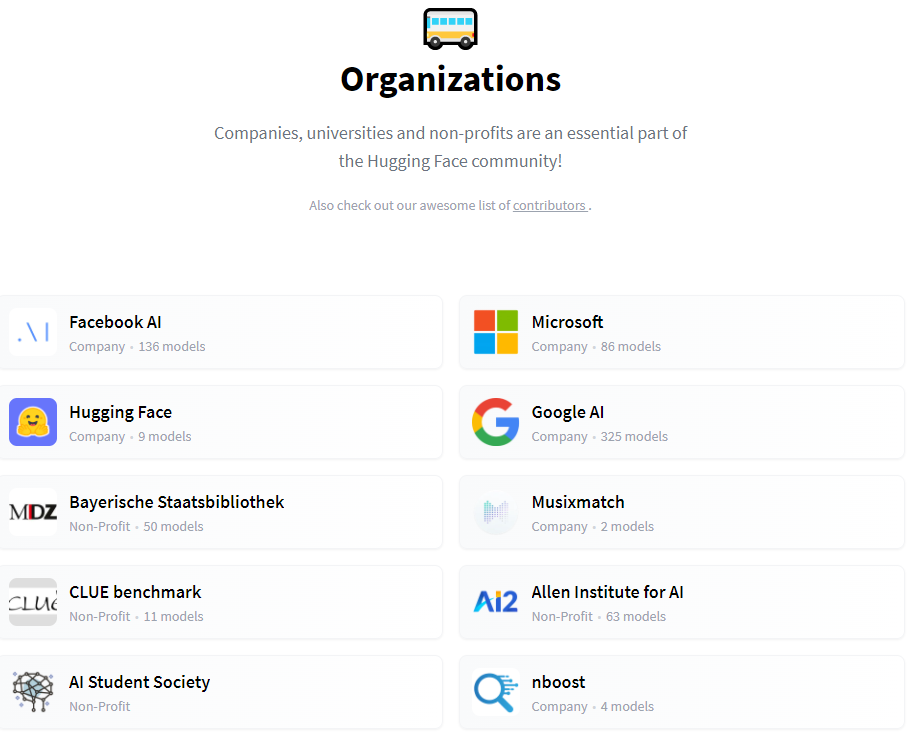

Hugging Face是一家非常活跃的人工智能创业公司。它拥有一个非常强大并且活跃的人工智能社区。有超过5000多家机构都在Hugging Face的社区发布内容,包括Google AI、Facebook AI、微软等。自从2016年成立以来,这家企业经历了5轮融资,总共募集了6000万美金。

那么,这是一家什么样的企业?为什么2016年才创立的企业,能有如此大的号召力?本文将简要介绍这家企业相关的信息。

加载中...

Hugging Face是一家非常活跃的人工智能创业公司。它拥有一个非常强大并且活跃的人工智能社区。有超过5000多家机构都在Hugging Face的社区发布内容,包括Google AI、Facebook AI、微软等。自从2016年成立以来,这家企业经历了5轮融资,总共募集了6000万美金。

那么,这是一家什么样的企业?为什么2016年才创立的企业,能有如此大的号召力?本文将简要介绍这家企业相关的信息。

欢迎关注 DataLearner 官方微信,获得最新 AI 技术推送

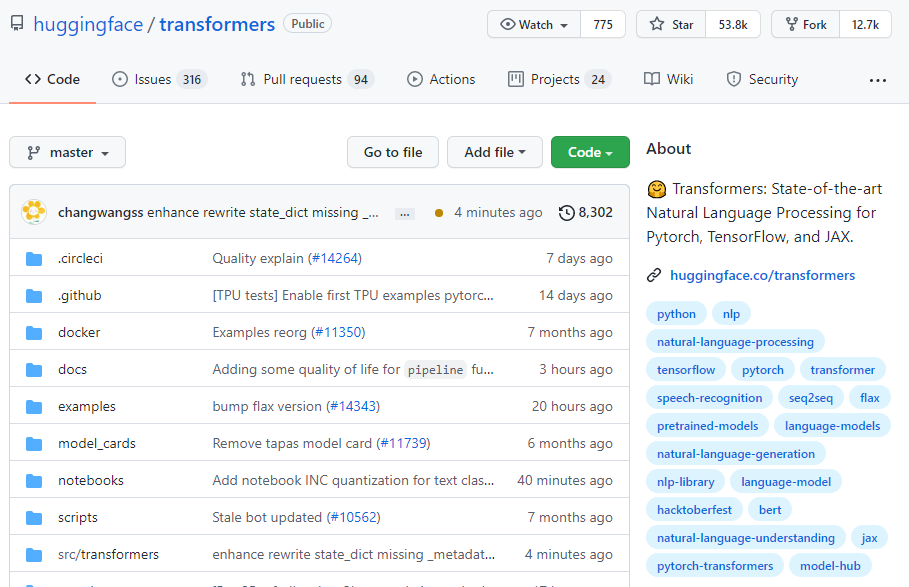

Hugging Face创立于2016年。最早是一家开发聊天机器人的企业。他们的目标是使用聊天机器人为无聊的年轻人解闷。当然,这样的创意虽然看起来很好,但显然并没有做得很大。HuggingFace的转变主要来源于它在NLP领域的贡献。在Bert发布不久之后,他们贡献了一个基于Pytorch的Bert预训练模型,即pytorch-pretrained-bert。相信这个库很多人都使用过,这个库非常好用,于是也顺着NLP模型的发展不断扩张。如今,HuggingFace整合了他们的贡献的NLP领域的预训练模型,发布了Transformers库。Transformers 提供了数以千计的预训练模型(包括我们熟知的Bert、GPT、GPT-2、XLM等),支持 100 多种语言的文本分类、信息抽取、问答、摘要、翻译、文本生成。它的宗旨让最先进的 NLP 技术人人易用。

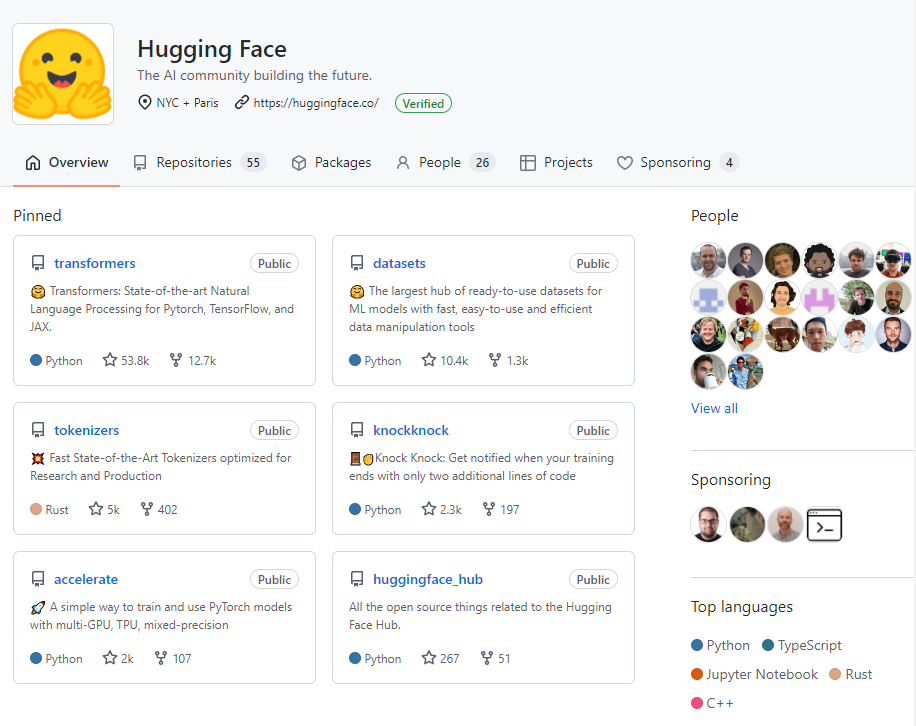

如今的Transformers在GitHub上已经有5.38万个stars,被fork了1.27万次。足以证明它的火爆。除此之外,他们还提供了datasets库用以方便访问公开的NLP数据集等很多优秀的工具。HuggingFace也凭借他们贡献的这些内容,吸引了大批的开发者。因此,他们也顺理成章地建立了自己的社区,也吸引了大批的机构入驻。

如今,HuggingFace的官方网站已经是一个大型的人工智能社区。他们运营着很多产品。HuggingFace的社区模式与我们现有的社区不一样。他们相当于一个机构的品牌专区。每一个机构可以在上面发布自己的模型、数据集和Spaces(这是才出来的一个托管AI应用或者展示AI应用的东西)。

从图中我们可以看到,Facebook AI发布了136个模型,微软发布了86个模型等等。当然,除了这种比较新的可以让大家管理宣传自己AI能力的社区,HuggingFace也有discord社区、community社区和博客等。此外,由于他们的NLP实力很强,他们也在官网中提供了自己的基于NLP的服务和报价,包括直接的专家支持、推断API和AutoNLP等业务。可以帮助我们解决企业的NLP相关的问题。总结一下,他们提供的服务如下:

机构品牌发布模型、数据集、AI应用展示的社区

开源的模型、数据集、工具库

NLP相关的解决方案

NLP相关的课程

Hugging Face在人工智能领域的影响力很大,运营着很大的一个社区。它的成长转变也是因为贡献了基于pytorch的bert而发生了很大的变化。目前,它们的社区非常活跃,也在持续地贡献优秀的产品。像他们提供的transformers、tokenizers、datasets、accelerate库都对NLP相关的实践产生了很大的促进。此外,各大公司在它的社区的贡献和支持,也让这家企业的社区更加活跃和健康。国内其实应该也需要这样的企业和氛围。不仅需要一些愿意做“贡献”的优秀企业,也需要各个巨头可以放下身段参与社区的建设,支持一些初创的小企业。而不是一味地互相斗争,计算一些鸡毛蒜皮的利益,搞得大家都没了尊重,只剩下啧啧啧了~~respect